Tous les parents ne connaissent que trop bien l’un des grands défis de l’éducation des enfants : leur apprendre à faire ce qu’on leur dit, mais pas ce qu’on fait.

Le même problème se pose désormais avec l’Intelligence Artificielle (IA).

De plus en plus d’applications et de logiciels se reposent sur l’IA pour automatiser certaines tâches, à l’aide d’un modèle d’apprentissage populaire, le « word embedding », qui s’appuie sur l’exploitation d’un grand nombre de données. Mais ce modèle a assimilé un certain nombre de préjugés… Lors d’activités comme la traduction automatique, il réutilise discrètement ces préjugés, ce qui a de quoi inquiéter. Plus tôt cette année, par exemple, les réseaux sociaux ont commencé à donner plusieurs exemples de préjugés sexistes repérés sur Google Translate.

En essayant par exemple de traduire certains termes en anglais, depuis le turc, qui a des pronoms neutres, une phrase comme o bir muhendis (où le sexe n’est pas précisé) devient he is an engineer (il est ingénieur), tandis que o bir hemsire est traduit par she is a nurse (elle est infirmière).

Le service de traduction de Microsoft, sur Bing, rencontre les mêmes difficultés face à l’emploi du genre, comme les articles le et la en français, ou der et die en allemand. Lorsque Bing traduit the table is soft (la table est douce) en allemand, il propose le féminin die Tabelle qui est en fait un tableau. « Ces associations genrées sont projetées sur des objets », nous explique Kate McCurdy, linguiste computationnelle senior à la startup d’apprentissage linguistique Babbel, à Berlin. C’est elle qui a découvert l’existence de ce biais linguistique chez Bing. « Les objets qui sont grammaticalement masculins ont tendance à recevoir des attributs masculins, continue-t-elle. Le logiciel apprend à assimiler ces stéréotypes de genre et les projette sur l’ensemble des noms de la langue ».

Les algorithmes de traduction répètent ces préjugés notamment parce que l’une des méthodes de machine learning les plus répandues, utilisée par Google Translate, mais aussi les algorithmes de recommandations de Google Search, Netflix ou Spotify, est celle qu’on appelle le word embedding. « Cette approche est très en vogue, et très répandue dans ce milieu, et c’est pour ça qu’il est primordial de questionner ses présupposés sous-jacents », ajoute Mme McCurdy.

Le word embedding fonctionne en associant un mot à un vecteur numérique, que l’algorithme peut ensuite utiliser pour calculer des probabilités et des fréquences. En repérant quels mots ont le plus tendance à se retrouver autour d’un mot donné, comme « ingénieur », le modèle peut voir quels autres mots semblent le plus adaptés, comme « il ». Le problème lorsqu’on apprend à partir de corpus de textes et de dialogues existants, c’est que ce type de modèle assimile ces inégalités ou stéréotypes de genre que l’on retrouve dans la vie en termes d’emplois ou d’opportunités. Une étude de 2016 qui a entraîné ce type d’algorithme à partir d’articles sur Google a montré la répétition de stéréotypes de genre « dans une mesure inquiétante », ont prévenu les chercheurs. Mme McCurdy explique qu’il n’y a rien de foncièrement mauvais avec le modèle du word embedding lui-même, mais qu’il a besoin d’une direction et d’une supervision humaines.

« Ce qu’il fait maintenant éviter, développe-t-elle, c’est de construire ces applications et de les lâcher dans la nature en s’attaquant aux problèmes au fur et à mesure qu’ils apparaissent. Mais si l’on est plus consciencieux et qu’on prend le temps de sérieusement réfléchir à cela, nous travaillerons davantage pour intégrer une perspective critique à l’élaboration du modèle. »

Les entreprises qui utilisent le word embedding dans des services destinés aux clients doivent diversifier leurs équipes de programmation, pour qu’elles repèrent plus efficacement les risques de biais linguistiques avant qu’ils ne posent problème.

« Si nous voulons vraiment que l’intelligence artificielle puisse prendre des décisions qui ne finissent pas par renforcer certains préjugés, il nous faudra impliquer des gens plus diversifiés et plus critiques bien plus tôt dans le processus de conception », conclut-elle.

Vous avez aimé cet article ? Likez Forbes sur Facebook

Newsletter quotidienne Forbes

Recevez chaque matin l’essentiel de l’actualité business et entrepreneuriat.

Abonnez-vous au magazine papier

et découvrez chaque trimestre :

- Des dossiers et analyses exclusifs sur des stratégies d'entreprises

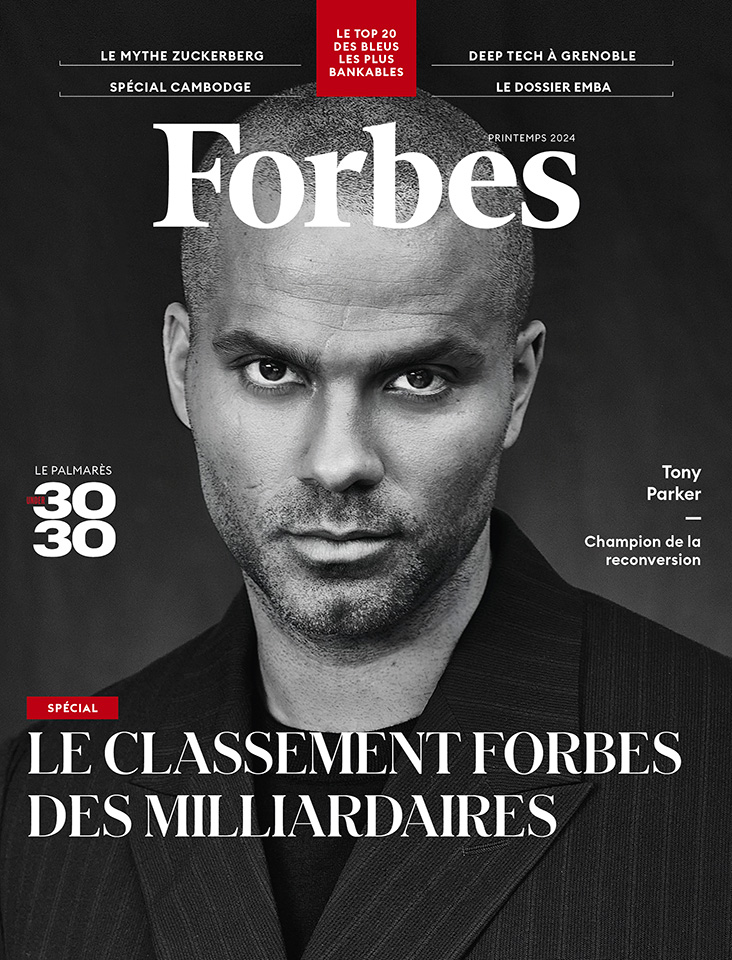

- Des témoignages et interviews de stars de l'entrepreneuriat

- Nos classements de femmes et hommes d'affaires

- Notre sélection lifestyle

- Et de nombreux autres contenus inédits

Image par Gerd Altmann de Pixabay

Image par Gerd Altmann de Pixabay