Répondre aux questions des utilisateurs est l’une des principales fonctions des assistants personnels intelligents. Alexa, Cortana, l’assistant Google et Siri ont accès à des outils de recherches reposant sur l’intelligence artificielle et qui permettent de vous faciliter l’accès aux innombrables informations présentes sur Internet. Vous n’avez qu’a demander.

Du moins, en théorie. Stone Temple a décidé de tester les capacités de réponse de ces fameux assistants virtuels. Les résultats sont très décevants, et c’est le moins que l’on puisse dire. Les performances vont de tout juste passables à épouvantables. Seul un assistant a reçu une note acceptable, alors que deux d’entre eux n’ont pas su répondre à la moitié des questions posées. En réalité, ces appareils sont tout sauf intelligents. Bienvenu chez Dumb and Dumber.

Le test

Stone Temple a posé 4 492 questions à Alexa (Amazon), Cortana (Microsoft), aux assistants de Google (smartphone et Home) et à Siri (Apple). Les réponses étaient considérées comme correctes seulement si l’assistant donnait toutes les informations demandées, sans avoir besoin de faire d’autres recherches.

Ce test est très difficile. Une réponse apportant des informations ne répondant pas à la question ou même partiellement sont incorrectes. Les critères de réussite de Stone Temple mettent la barre haut, mais ces attentes sont justifiées. Lorsque nous posons une question à un assistant virtuel, nous attendons une réponse, et non des informations non pertinentes ou incomplètes.

Les résultats

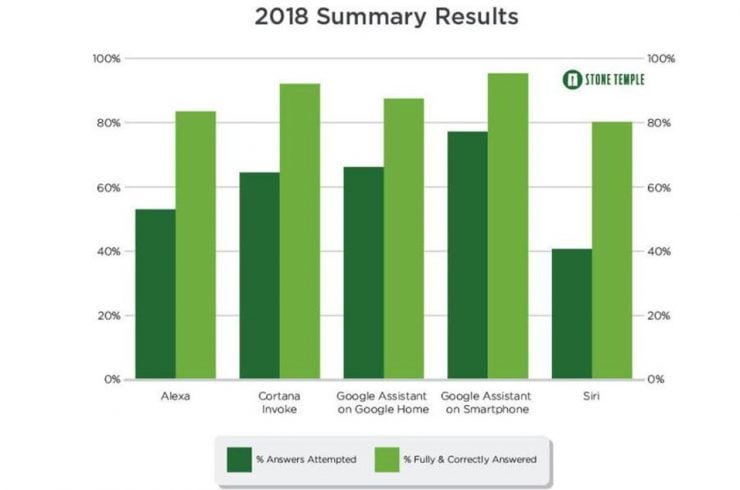

Stone Temple résume les résultats des tests au graphique ci-dessus, qui présente le pourcentage de questions auxquelles les assistants ont tenté de répondre sans succès, et le pourcentage de questions auxquelles ils ont répondu correctement. Le pourcentage de réponses incorrectes est un bon indice des capacités de l’assistant. Par exemple, Alexa a seulement tenté de répondre à 53,4 % de questions et Siri à moins de la moitié. Cela ne met pas trop l’utilisateur en confiance.

Cette méthode de présentation des résultats ne permet pas de voir directement quel pourcentage des 4 492 questions ont été correctement élucidées. Voici donc les résultats reposant sur les données brutes qui nous ont été communiquées par Stone Temple.

| Assistant virtuel | # de bonnes réponses | % de bonnes réponses |

|---|---|---|

| Assistant Google pour smartphones | 3 639 | 74,6 |

| Cortana | 2 944 | 59,5 |

| Assistant Google Home | 2 868 | 58,0 |

| Alexa | 2 195 | 44,3 |

| Siri | 1 616 | 32,7 |

Alors qu’Alexa et Siri peuvent être considérés comme clairement déficients, aucun assistant ne s’en est sorti haut la main. Cependant, l’assistant Google pour smartphones ressort du lot, sans pour autant mériter une bonne note. Il n’est pas excellent mais il est de loin le meilleur.

L’une des principales fonctionnalités des assistants virtuels est de répondre aux questions. Et aucun d’eux ne le fait vraiment bien : deux sont réellement médiocres et deux autres en sont presque incapables.

Les attentes sont-elles trop élevées ?

Nous leur en demandons peut-être trop. Après tout, l’utilisateur non plus ne connais pas la réponse à sa question, sinon, il ne la poserait pas. Alors si ni l’utilisateur, ni l’assistant ne connaissent la réponse, cela veut-il dire qu’ils sont tous les deux stupides. Ne pas savoir répondre à 60 % des questions que l’on pose n’est pas très reluisant, mais savoir répondre à quelques questions et nous apprendre quelque chose de nouveau, c’est plutôt impressionnant, non ?

Si vous posez une question à quelqu’un concernant un sujet auquel vous n’y connaissez rien, cette personne apparaîtra intelligente à vos yeux si elle vous donne une réponse. Les escrocs et les manipulateurs utilisent cette technique car la plupart des gens pensent que de répondre à une question sur un sujet que l’on maîtrise est une réussite en soi. Tout le monde peut le faire, et la seule raison pour laquelle cela impressionne, c’est parce que la personne parle de quelque chose que vous ne connaissez pas.

Les assistants virtuels peuvent paraître intelligents pour les mêmes raisons, ils peuvent répondre à des questions dont la réponse est inconnue de l’utilisateur. Mais pensez aux extraordinaires ressources mises à leur disposition. Les humains cherchent des réponses dans leurs expériences personnelles. Les assistants quant à eux font appel à Internet. Les humains font appel à leur mémoire, qui n’est malheureusement pas infaillible. Les assistants utilisent des outils de recherche puissants reposant sur des systèmes d’intelligence artificielle. Comme Google. Cet outil est très performant, et Cortana et Siri s’en servent pour répondre à des questions générales.

Amazon, Microsoft, Google et Apple sont des géants du secteur de la tech. Ils disposent de milliards de dollars, de gigantesques clusters de serveurs et d’une expertise de pointe. Et ils ne peuvent pas faire mieux que de répondre à 60 % des questions posées (à part pour l’assistant Google pour smartphones) ? Stone Temple a donné des exemples de questions auxquelles les assistants n’ont pas su répondre. Dans la majorité des cas, la réponse se trouve sur Internet et est très facile à trouver. Cependant, les assistants virtuels ne la trouve pas, et parfois, ils n’essaient même pas. Avec un niveau de réussite similaire, un étudiant ne pourrait jamais obtenir son diplôme.

Le concept d’assistant virtuel est très intéressant. Ils sont actuellement très utiles et ils vont certainement s’améliorer. Mais cela n’enlève rien au fait que si vous commercialisez un produit prétendant pouvoir vous faciliter l’accès aux informations présentes sur Internet, il est nécessaire d’améliorer son fonctionnement. Aucun de ces assistants n’est réellement intelligent lorsqu’il s’agit de répondre à des questions et la plupart d’entre eux peuvent être comparés à des dumb and dumber modernes.

Vous avez aimé cet article ? Likez Forbes sur Facebook

Newsletter quotidienne Forbes

Recevez chaque matin l’essentiel de l’actualité business et entrepreneuriat.

Abonnez-vous au magazine papier

et découvrez chaque trimestre :

- Des dossiers et analyses exclusifs sur des stratégies d'entreprises

- Des témoignages et interviews de stars de l'entrepreneuriat

- Nos classements de femmes et hommes d'affaires

- Notre sélection lifestyle

- Et de nombreux autres contenus inédits

Crédit Flickr

Crédit Flickr