Alors que les investisseurs placent des milliards dans les outils d’IA générative, le monde commence à se poser des questions complexes sur une technologie qui bouleverse tous les aspects de la vie.

Un article de Rashi Shrivastava pour Forbes US – traduit par Lisa Deleforterie

L’ascension de l’IA en 2023

2023 a été l’année de l’intelligence artificielle. Après son lancement en novembre 2022, ChatGPT est devenue l’une des applications à la croissance la plus rapide, avec 100 millions d’utilisateurs mensuels en l’espace de deux mois. L’intelligence artificielle étant devenue le sujet le plus animé de l’année (comme Bill Gates l’avait prédit en janvier), une série de startups ont explosé sur le marché avec des outils d’IA capables de tout générer, de la voix synthétique aux vidéos. De toute évidence, l’IA a parcouru un long chemin depuis le début de l’année, lorsque les gens se demandaient si ChatGPT allait remplacer la recherche sur Google.

« Je suis beaucoup plus intéressé par la réflexion sur ce qui va bien au-delà de la recherche… Qu’est-ce que nous faisons de totalement différent et de beaucoup plus cool ? » a confié Sam Altman, PDG d’OpenAI, à Forbes en janvier.

Les progrès rapides de la technologie ont attiré l’attention des investisseurs en capital-risque, qui ont injecté des milliards de dollars dans le secteur. L’investissement de 10 milliards de dollars (9,1 milliards d’euros) de Microsoft dans le MVP OpenAI, qui serait actuellement valorisé à 80 milliards de dollars (73 milliards d’euros), a ouvert la voie. En juin, Inflection, une startup très en vue dans le domaine de l’IA, a lancé son chatbot Pi et a levé 1,3 milliard de dollars (1,18 milliard d’euros) pour une valorisation de 4 milliards de dollars (3,6 milliards d’euros). Un mois plus tard, Hugging Face, qui héberge des milliers de modèles d’IA open source, a atteint une valorisation de 4 milliards de dollars. En septembre, Amazon a annoncé son intention d’investir 4 milliards de dollars dans le challenger d’OpenAI, Anthropic, qui a lancé son propre chatbot conversationnel Claude 2.0 en juillet et est aujourd’hui évalué à 18,4 milliards de dollars (16,8 milliards d’euros), selon une source directement informée.

Mais tous les fondateurs d’IA n’ont pas eu un chemin direct vers la collecte de fonds. Stability AI a obtenu un financement d’un milliard de dollars (913 millions d’euros) en septembre 2022 pour son modèle d’intelligence artificielle texte-image populaire Stable Diffusion, mais a eu du mal à lever des fonds depuis. Son PDG, Emad Mostaque, a fait des déclarations trompeuses sur ses propres références et sur les partenariats stratégiques de l’entreprise auprès des investisseurs, comme l’a révélé une enquête de Forbes en juin. En décembre, une étude de Stanford a révélé que l’ensemble de données utilisé pour former Stable Diffusion contenait des informations illégales sur les abus sexuels commis sur des enfants.

La ruée vers l’or de l’IA a fait naître plusieurs autres licornes comme Adept, qui construit des assistants IA capables de naviguer sur l’internet et d’exécuter des logiciels à votre place, et Character AI, qui est utilisé par 20 millions de personnes pour créer et discuter avec des personnages de chatbot IA tels que Taylor Swift et Elon Musk. Les startups d’IA générative axées sur l’entreprise, telles que Typeface, Writer et Jasper, qui aident les entreprises à automatiser des tâches telles que la rédaction de courriels et le résumé de longs documents, ont également bénéficié d’un afflux de fonds. Mais dans cette course à la création et au lancement d’outils d’IA, Google s’est retrouvé au pied du mur et a dû rattraper son retard. Le géant technologique a lancé son chatbot d’IA conversationnelle Bard et son propre modèle d’IA Gemini à la fin de l’année.

Au cours de l’année écoulée, l’IA a pénétré pratiquement toutes les facettes de la vie. Les médecins et les hôpitaux ont commencé à utiliser des outils d’IA générative non seulement pour la prise de notes et le travail de bureau, mais aussi pour diagnostiquer les patients. Alors que certains candidats politiques ont commencé à déployer l’IA dans leurs campagnes pour interagir avec les électeurs potentiels, d’autres ont utilisé des outils d’IA générative pour créer des contrefaçons profondes de leurs adversaires politiques.

Les préoccupations quant à l’usage de l’IA

Les contenus générés par l’IA ont inondé l’Internet, suscitant des inquiétudes quant à l’exploitation d’outils d’IA largement disponibles pour créer des contenus dangereux. Par exemple, les fausses nouvelles produites à l’aide de logiciels d’IA générative sont devenues virales sur TikTok et YouTube, et le porno sans consentement généré par l’IA a proliféré sur Reddit et Etsy. Alors que les contenus de mauvaise qualité générés par l’IA envahissaient le web, ChatGPT a semé le trouble dans le monde des freelances, car beaucoup craignaient de perdre leurs contrats au profit des nouveaux logiciels d’IA à la mode, capables de produire des contenus plus rapidement et à moindre coût que les humains.

Les entreprises ont également utilisé des chatbots d’intelligence artificielle pour sélectionner, interviewer et recruter des employés, ce qui a mis en lumière les préjugés et les risques inhérents à cette technologie. Les cybercriminels ont trouvé ChatGPT utile pour écrire le code de logiciels malveillants et d’autres l’ont utilisé comme outil de surveillance des médias sociaux. Pour lutter contre certains de ces problèmes, des géants de la technologie comme Microsoft et Google ont engagé des « équipes rouges » pour rendre leurs propres modèles d’IA plus sûrs.

« Il y a encore beaucoup de questions non résolues », a déclaré Regina Barzila, professeure d’ingénierie électrique et d’informatique au MIT CSAIL. « Nous devons disposer d’outils capables de découvrir les problèmes et les biais présents dans ces ensembles de données, ainsi que de méta technologies d’IA capables de réguler l’IA et de nous aider à être dans une position beaucoup plus sûre que celle dans laquelle nous nous trouvons aujourd’hui avec l’IA. »

En 2023, des startups d’IA de premier plan comme OpenAI, Stability AI et Anthropic ont été frappées par une marée de procès pour violation de droits d’auteur intentés par des artistes, des écrivains et des codeurs, qui affirmaient que ces outils étaient construits sur de vastes ensembles de données qui utilisaient leur contenu protégé par des droits d’auteur sans consentement ni rémunération. L’expert juridique Edward Klaris prédit que ces recours collectifs créeront un espace pour de nouvelles règles nuancées autour de l’utilisation équitable de l’IA par le Bureau du copyright des États-Unis en 2024.

« Dans le monde juridique, il y a un grand nombre de transactions liées à l’IA. Certaines personnes sont contrariées par le fait que leur travail a été utilisé pour créer des données de formation et elles veulent donc pouvoir concéder des licences sur leur contenu aux entreprises d’IA et être payées pour l’utilisation de leur matériel », a déclaré M. Klaris, PDG et associé directeur du cabinet d’avocats KlarisIP, spécialisé dans les droits de propriété intellectuelle.

Après que l’Union européenne a cherché à réglementer la technologie par le biais de sa loi sur l’IA, le gouvernement Biden a publié son propre décret, exigeant que les startups développant de grands modèles d’IA susceptibles de poser des risques pour la sécurité nationale les divulguent au gouvernement. Si les entreprises technologiques ont largement soutenu ce décret, les startups craignaient qu’il n’entrave le rythme de l’innovation.

« Si vous regardez le décret, il formule des principes, ce qui est bien d’articuler, mais il ne se traduit pas vraiment par la façon dont nous prenons ces principes et les traduisons en une technologie ou un garde-fou qui nous aide à garantir que l’outil que nous utilisons est vraiment sûr », a déclaré Mme Barzilla.

2023 a également vu une fracture parmi les leaders de l’IA, qui sont divisés sur la question de savoir si la technologie de l’IA devrait être développée ouvertement ou par des entreprises puissantes à huis clos, comme Google, OpenAI et Anthropic. Certains ont évoqué les problèmes de sécurité liés à l’ouverture des modèles d’IA, car n’importe qui pourrait manifestement les utiliser à mauvais escient. D’autres, comme Yann LeCun, scientifique en chef de Meta AI, qui a supervisé le développement du modèle open source de Meta, Llama 2, sont partisans de tests de résistance de l’IA open source de manière ouverte et transparente.

« Les grands modèles linguistiques open source atteindront le niveau des grands modèles linguistiques fermés en 2024 », a déclaré Clément Delangue lors d’une conférence de presse.

Une division interne a été rendue publique fin novembre lorsque le PDG d’OpenAI, Sam Altman, a été évincé de l’entreprise par son conseil d’administration, qui a estimé qu’il n’avait pas été « franc » dans ses démarches auprès du conseil. Quelques jours plus tard, il a été réintégré dans ses anciennes fonctions de PDG, après que des employés ont menacé de quitter l’entreprise si M. Altman ne revenait pas. L’entreprise a également accueilli de nouveaux administrateurs au sein de son conseil d’administration, dont Bret Taylor et Larry Summers.

Les enjeux de 2024

Les questions clés auxquelles il faudra répondre en 2024 concernent l’économie de l’IA, a déclaré M. Delangue, et plus précisément la manière dont ces startups de l’IA parviendront à dégager des marges bénéficiaires et à faire gagner de l’argent à leurs investisseurs. S’appuyant sur les processeurs graphiques des géants des semi-conducteurs comme Nvidia et AMD, la plupart des modèles d’IA sont de plus en plus coûteux et ont une forte empreinte carbone car ils doivent être entraînés sur de grandes quantités de données. « En 2024, la plupart des entreprises réaliseront que des modèles plus petits, moins chers et plus spécialisés sont plus judicieux pour 99 % des cas d’utilisation de l’IA », a déclaré M. Delangue.

Vous avez aimé cet article ? Likez Forbes sur Facebook

Newsletter quotidienne Forbes

Recevez chaque matin l’essentiel de l’actualité business et entrepreneuriat.

Abonnez-vous au magazine papier

et découvrez chaque trimestre :

- Des dossiers et analyses exclusifs sur des stratégies d'entreprises

- Des témoignages et interviews de stars de l'entrepreneuriat

- Nos classements de femmes et hommes d'affaires

- Notre sélection lifestyle

- Et de nombreux autres contenus inédits

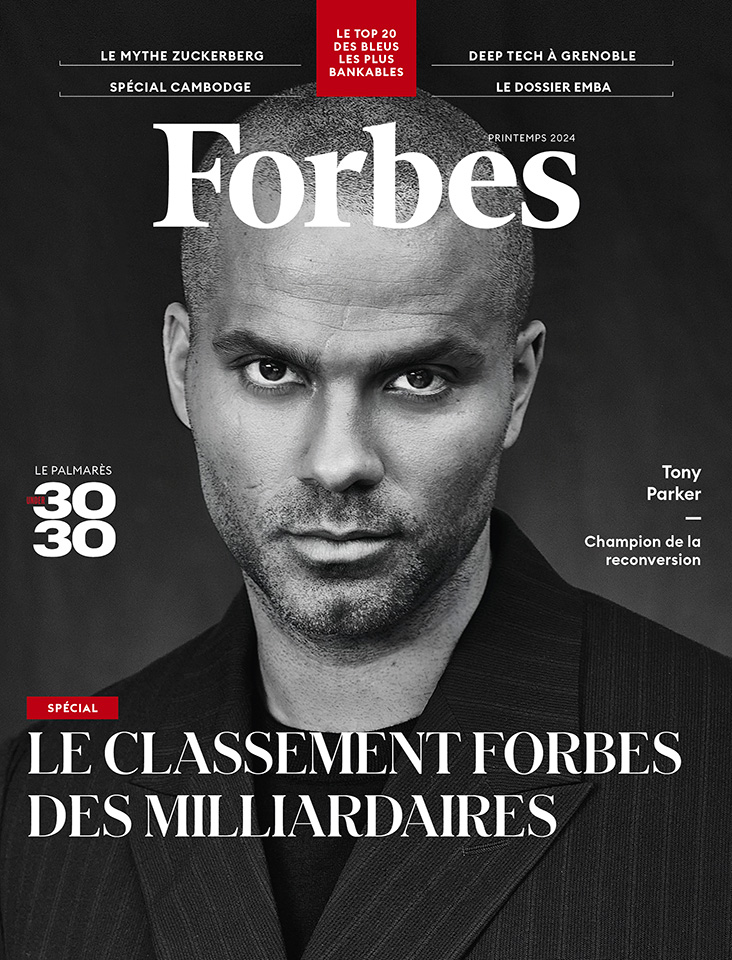

La démocratisation de l’IA en 2023. Getty Images

La démocratisation de l’IA en 2023. Getty Images