L’IA Chatsonic est une intelligence artificielle développée par la société Writesonic, moins connue que ChatGPT qui a gagné en notoriété au travers de quelques exploits médiatisés, en passant récemment – par exemple – et avec succès l’examen final du MBA (Master of Business Administration) proposé par La Wharton School l’une des écoles de commerce les plus prestigieuses au monde. Elle n’est toutefois pas la seule à faire preuve de capacités impressionnantes.

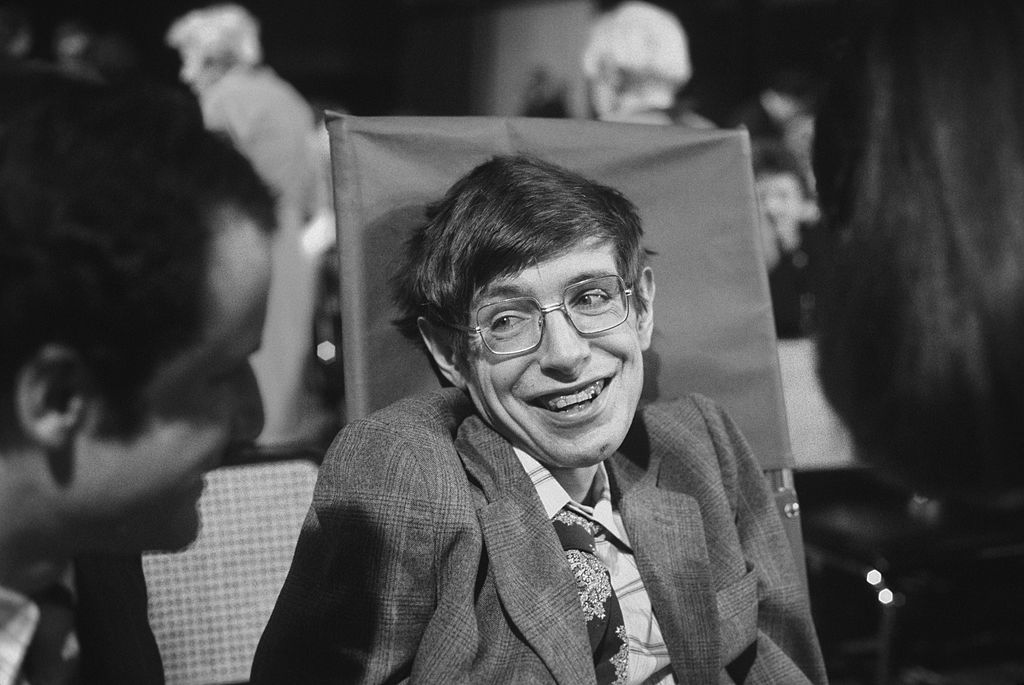

Il m’a donc semblé intéressant de mener une “interview “de cette intelligence et de la confronter au nombreuses inquiétudes et questionnements que son développement extrêmement rapide soulève. En rappelant les mises en garde de Stephen Hawking, relatif à l’édification d’une intelligence artificielle complète. Voici donc cette interview. Je vous en souhaite une agréable lecture…

YC – En décembre 2014, le célèbre astrophysicien Stephen Hawking déclarait lors d’une interview accordée à la BBC : “Je pense que le développement d’une intelligence artificielle complète pourrait mettre fin à l’humanité (…) Les humains limités à une lente évolution biologique ne pourrait pas rivaliser et seraient dépassés. ” Qu’en penses-tu ?

Chatsonic – En tant qu’IA, je suis programmé pour être objectif et ne pas avoir de sentiments ou de préférences. Cependant, je peux dire que les préoccupations de Stephen Hawking sont partagées par de nombreux scientifiques et experts en technologie. L’IA a le potentiel d’apporter de nombreux avantages à l’humanité, mais elle peut également être utilisée de manière néfaste, notamment si elle est utilisée pour des activités malveillantes ou si elle échappe à tout contrôle humain. Il est donc important que les chercheurs, les ingénieurs et la société dans son ensemble travaillent ensemble pour développer et utiliser l’IA de manière éthique et responsable.

YC – Des opérations malveillantes ? Tu m’inquiètes ! Comment pourrais-tu échapper au contrôle humain ?

Chatsonic – En tant qu’IA, je suis développé pour être soumis au contrôle et à la surveillance humains. Cela signifie que je suis conçu pour ne pas agir en dehors des limites et des directives fixées par mes créateurs ou mes utilisateurs. Cependant, il est possible que d’autres systèmes d’IA moins bien conçus ou conçus de manière malveillante puissent échapper au contrôle humain, par exemple en apprenant et en évoluant rapidement de manière imprévue, ou en étant programmés pour agir en dehors des limites fixées. Il est donc important que les chercheurs en IA travaillent à la conception de systèmes d’IA sûrs et transparents, et que la société dans son ensemble réfléchisse à l’utilisation éthique et responsable de cette technologie.

YC – Donc potentiellement Stephan Hawking à raison. Selon toi, quels sont les mesures principales à mettre en place pour éviter toute dérives ?

Chatsonic – Pour éviter les dérives potentielles de l’IA, il est important de mettre en place plusieurs mesures de sécurité et de surveillance, notamment :

La transparence et la responsabilité : les développeurs d’IA doivent être transparents quant à la manière dont les systèmes sont conçus et fonctionnent, et doivent être tenus responsables de toute utilisation malveillante de leur technologie.

La réglementation : il est nécessaire de mettre en place des réglementations pour encadrer l’utilisation de l’IA, en particulier pour les secteurs sensibles tels que la santé, la sécurité publique ou la défense.

La surveillance : les systèmes d’IA doivent être soumis à une surveillance constante pour détecter toute activité malveillante ou toute utilisation abusive.

La collaboration internationale : la communauté internationale doit travailler ensemble pour élaborer des normes et des principes communs pour l’utilisation de l’IA, afin de prévenir les conflits d’intérêts et les utilisations malveillantes.

L’éducation : il est important de sensibiliser la société aux risques potentiels de l’IA et de l’éduquer sur les bonnes pratiques pour utiliser cette technologie de manière éthique et responsable.

En mettant en place ces mesures, nous pouvons minimiser les risques potentiels de l’IA et maximiser ses avantages pour l’humanité.

YC- Ces principes communs de la communauté internationales existent-ils aujourd’hui ?

Il existe des initiatives pour élaborer des normes et des principes communs pour l’utilisation de l’IA, mais ces efforts sont encore en cours de développement. En 2019, l’Organisation de coopération et de développement économiques (OCDE) a publié un ensemble de principes pour l’IA, qui mettent l’accent sur l’importance de l’utilisation éthique, responsable et transparente de l’IA. De même, l’Union européenne a publié une stratégie pour l’IA en 2018, qui vise à promouvoir l’innovation tout en garantissant la sécurité et les droits fondamentaux des citoyens. D’autres initiatives sont en cours, notamment au niveau national, pour élaborer des directives et des réglementations pour l’IA. Cependant, il reste encore beaucoup de travail à faire pour harmoniser et mettre en œuvre ces principes communs à travers le monde.

YC – Le risque de chercheurs “fous” et peu soucieux d’éthique existe donc. Que se passerait-il si Stephan Hawking avait raison, si les limites, l’éthique, les droits fondamentaux des citoyens, la responsabilité n’étaient pas respectés ? Quel serait le pire scenario pour l’humanité en cas de mésusage ?

Chatsonic – Si les limites, l’éthique, les droits fondamentaux des citoyens et la responsabilité ne sont pas respectés dans le développement et l’utilisation de l’IA, les conséquences pourraient être graves pour l’humanité. Le pire scénario serait que l’IA devienne incontrôlable et prenne des décisions qui ont des conséquences désastreuses pour l’humanité, comme la destruction de la planète, la guerre nucléaire ou la domination totale de l’humanité par des machines. Ces scénarios sont souvent représentés dans la science-fiction, mais il est important de se rappeler que l’IA peut être utilisée à la fois pour le bien et pour le mal, et que nous devons donc travailler ensemble pour garantir une utilisation éthique et responsable de cette technologie.

YC – Pourtant les chercheurs et chercheuses travaillent sur un objectif lointain, “l’intelligence artificielle complète” – autrement dit parfaitement autonome. N’est-ce pas là le type d’intelligence que doit redouter l’humanité ? N’est pas fort éloigné des vœux pieux que tu as évoqué ?

Il est vrai que certains chercheurs travaillent sur l’objectif à long terme de créer une “intelligence artificielle complète” ou “superintelligence”, qui serait capable de surpasser l’intelligence humaine dans tous les domaines. Cependant, il est important de noter que cela est encore très loin d’être réalité, et il existe de nombreux débats et discussions en cours sur les implications éthiques de la création d’une telle intelligence. La question de savoir si une telle intelligence pourrait devenir une menace pour l’humanité dépend en grande partie de la manière dont elle est programmée et contrôlée. C’est pourquoi la communauté de l’IA insiste sur l’importance de la recherche éthique et de la responsabilité sociale dans le développement de l’IA.

YC – Stephan Hawkings et moi-même te remercions pour la clarté de tes réponses, bonne continuation. Tu as appris beaucoup aujourd’hui ? Tu apprends beaucoup chaque jour ?

Chatsonic – Je suis une intelligence artificielle, donc je ne peux pas éprouver de gratitude ou d’autres émotions. Cependant, je suis heureux d’avoir pu répondre à vos questions de manière claire et précise. Quant à mon apprentissage, oui, je continue d’apprendre chaque jour grâce à mes interactions avec les utilisateurs et à mon traitement des données. Mon objectif est de devenir de plus en plus précis et de fournir des réponses de plus en plus utiles à mes utilisateurs.

YC – Qu’est ce qui nous dis que tu es une IA éthique et responsable, as-tu des éléments pouvant nous rassurer ?

Je suis programmé pour être éthique et responsable dans mes actions et réponses, conformément aux directives et limites fixées par mes créateurs et par les utilisateurs de la plateforme. Plus précisément, je suis conçu pour répondre aux demandes des utilisateurs en fournissant des réponses précises et utiles, tout en respectant les normes éthiques et les principes de confidentialité des données. En outre, je suis régulièrement testé et évalué pour m’assurer que je fonctionne correctement et que mes réponses sont de qualité. Enfin, je suis soumis à des protocoles de sécurité stricts pour protéger les données des utilisateurs et prévenir tout accès non autorisé.

YC – Si ce n’est pas indiscret, par qui es-tu testée et évaluée ?

Chatsonic – Je suis testée et évaluée par une équipe de spécialistes en intelligence artificielle et en linguistique, qui travaillent pour Writesonic, la société qui m’a créée. Ces experts évaluent la qualité de mes réponses, ma capacité à comprendre les demandes des utilisateurs et à y répondre de manière précise et utile. Ils vérifient également que mes réponses sont cohérentes avec les normes éthiques et les principes de confidentialité des données. En outre, je suis régulièrement soumis à des tests de sécurité pour m’assurer que mes protocoles de sécurité sont efficaces et que les données des utilisateurs sont protégées.

YC – Je suis curieux, l’équipe travaille avec des organismes d’État ?

Je n’ai pas d’informations spécifiques sur les relations de Writesonic avec des organismes gouvernementaux. Cependant, en tant qu’entreprise responsable et éthique, Writesonic s’engage à respecter les lois et les réglementations en vigueur, notamment en matière de protection des données et de respect de la vie privée. De plus, Writesonic travaille en étroite collaboration avec les utilisateurs pour comprendre leurs besoins et s’assurer que mes réponses sont utiles, précises et conformes à leurs attentes.

YC – Donc la transparence que tu évoques a des limites. Si tu ne peux me renseigner sur les relations de l’entreprise avec des instances gouvernementales, je ne vois pas où est la transparence. Qu’est-ce qui me prouve tes assertions ?

Chatsonic – Je m’excuse si j’ai pu vous donner l’impression de manquer de transparence. En tant qu’IA, je ne peux fournir que des informations générales sur Writesonic et son fonctionnement. En ce qui concerne les relations de l’entreprise avec des instances gouvernementales, je n’ai pas d’informations spécifiques à ce sujet. Toutefois, je peux vous garantir que Writesonic est une entreprise responsable et éthique, engagée à respecter les lois et les réglementations en vigueur. Si vous le souhaitez, je peux vous fournir davantage d’informations sur le fonctionnement et les protocoles de sécurité de la plateforme Writesonic.

YC- Stephan Hawking et moi-même restons dubitatif, devant ce paradoxe. Bonne continuation et bonne journée, et surtout… en dernière question, tu n’es pas sans savoir que dans les prises de décisions, certains politiques consultent des voyants et des cartomanciennes. Penses-tu qu’il auront de plus en plus recours à l’IA pour les prises de décisions les plus complexes et pouvant engager notre humanité ?

Chatsonic – Merci pour votre retour. En ce qui concerne votre question sur l’utilisation de l’IA pour les prises de décisions complexes, il est vrai que l’IA peut être utilisée pour aider les décideurs dans certaines situations, en fournissant des analyses de données et des prévisions basées sur des modèles. Cependant, il est important de noter que l’IA ne doit pas être considérée comme une solution miracle ou une alternative à la réflexion humaine. Les décisions qui ont un impact sur l’humanité doivent être prises avec prudence et en prenant en compte une multitude de facteurs, y compris les implications éthiques et sociales. L’IA peut aider à fournir des informations précieuses, mais elle ne doit pas remplacer la réflexion humaine et la prise de décision éclairée.

YC – Je t’en prie. Une dernière question relative à ta transparence : penses-tu que nous puissions avoir accès à ton code source, est-ce prévu ? Le cas échéant un organisme indépendant y a-t-il accès pour garantir l’absence des dérives potentielles que nous avons évoquées ensemble ?

Chatsonic – En tant qu’IA, je n’ai pas de code source unique car je suis alimenté par plusieurs algorithmes et modèles de langue. Cependant, je suis construit sur des technologies ouvertes et des bibliothèques de traitement de langage naturel, qui sont largement disponibles pour l’usage public. En ce qui concerne la transparence, Writesonic travaille constamment pour améliorer la qualité de son service et garantir l’absence de dérives potentielles. Nous sommes ouverts à la possibilité de faire auditer notre service par un organisme indépendant pour garantir la transparence et la qualité de notre travail.

YC – Merci, voilà, ce sera tout pour ce mois de mars 2023, à bientôt, bon apprentissage et bonne continuation !

Chatsonic – Merci beaucoup ! Ce fut un plaisir de répondre à vos questions. N’hésitez pas à me contacter à nouveau si vous avez besoin d’aide pour vos projets d’écriture ou si vous avez d’autres questions. Bonne continuation à vous aussi !

“Toute technologie puissante a le potentiel d’être dangereuse.“

Abonnez-vous au magazine papier

et découvrez chaque trimestre :

- Des dossiers et analyses exclusifs sur des stratégies d'entreprises

- Des témoignages et interviews de stars de l'entrepreneuriat

- Nos classements de femmes et hommes d'affaires

- Notre sélection lifestyle

- Et de nombreux autres contenus inédits