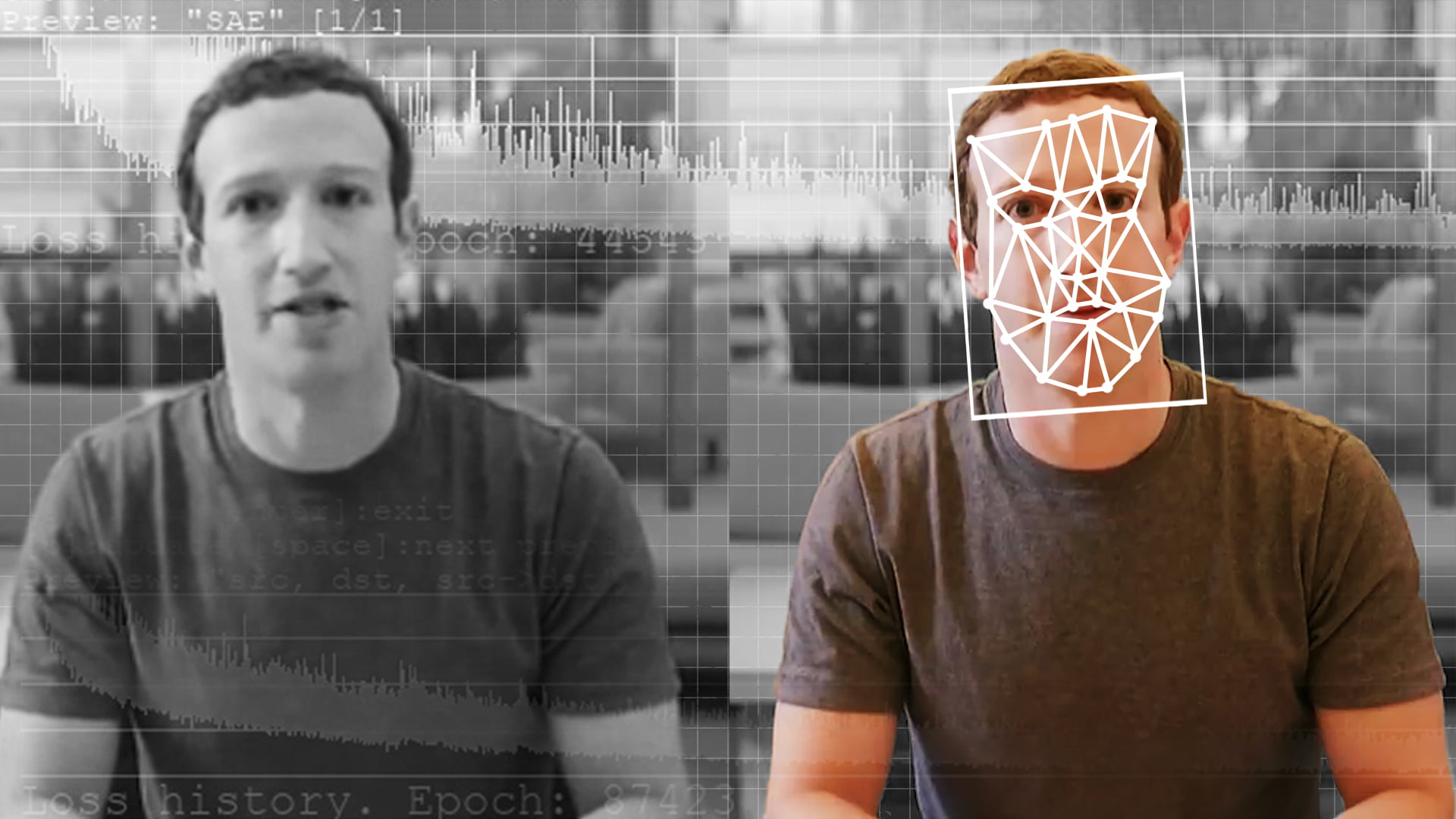

L’hypertrucage (ou deepfake) n’est plus une technologie inconnue du grand public : des millions de spectateurs ont pu apprécier ses effets miraculeux dans le documentaire Get Back de Disney+ sur les Beatles. Néanmoins, rares sont ceux et celles qui ont réalisé que la technologie utilisée pour faire apparaître John, Paul, George et Ringo à l’écran est également reprise à des fins moins glorieuses.

La grande majorité des experts en cybersécurité considère les algorithmes utilisés pour créer des hypertrucages (terme désignant les imitations générées par l’intelligence artificielle, AI) comme un défi majeur auquel la société sera confrontée dans les années à venir.

Il existe déjà des sites internet capables de créer des images pornographiques de personnalités réelles à partir de n’importe quelles images ou vidéos ordinaires : une atteinte évidente à la vie privée aux conséquences potentiellement dramatiques. Dans la sphère politique, l’on a déjà vu (et entendu) des « faussaires » utilisés cette technologie pour transformer un discours de Barack Obama. Certes, cela a été réalisé à des fins éducatives, cependant les risques d’abus sont bien présents.

Parallèlement, l’hypertrucage peut également s’avérer très utile. À l’instar de la boîte de Pandore de la mythologie grecque, maintenant que cette boîte a été ouverte, elle ne peut plus être refermée : plus de 80 applications d’hypertrucage open source existent déjà sur Github.

Selon Eric Haller, directeur des services d’identité d’Experian, la création d’hypertrucages peut être considérée comme le dernier développement dans la guerre perpétuelle entre les entreprises et la contrefaçon. « Pensez aux vieux films d’espionnage et aux espions qui tentent de savoir si la vidéo qu’ils regardent est réelle ou non. Toutes ces choses se produisent aujourd’hui, ce n’est pas une notion nouvelle », affirme Eric Haller.

Contrairement au documentaire sur les Beatles, où l’IA a juste été utilisée pour retoucher et restaurer les détails manquants, les enquêteurs sont désormais amenés à analyser des documents créés à 100 % par des ordinateurs.

La technologie étant ce qu’elle est aujourd’hui, il y a peu de chances que l’hypertrucage réussisse à tromper un expert. Par exemple, votre propre avatar doté d’une voix d’IA peut très bien vous faire tenir un certain discours pour créer une présentation virtuelle ou un webinaire. Cependant, une personne qui vous connaît bien pourrait déceler de petites différences dans l’intonation et l’élocution qui trahissent le fait que le contenu soit généré par ordinateur.

Selon Eric Haller, même les hypertrucages de Tom Cruise sur TikTok (qui sont sûrement les exemples les plus répandus du phénomène) ont été réalisés par un acteur ou un imitateur compétent, capable d’imiter les manières de Tom Cruise de façon impressionnante. À l’aide d’algorithmes connus sous le nom de réseau antagoniste génératif (GAN), l’IA se contente ensuite de « brouiller » les données audio et visuelles pour les aligner encore plus étroitement sur la star hollywoodienne. Même après tout cela, le travail n’est pas assez parfait pour tromper une grande partie du public. En effet, la réaction la plus fréquente à la vue de la séquence est « c’est un faux très convaincant », plutôt que « c’est Tom Cruise ! ».

Évidemment, le danger vient du fait que cette technologie n’en est qu’à ses débuts. Dans cinq ou dix ans, il est tout à fait plausible que l’hypertrucage permette de créer des contrefaçons impossibles à distinguer de la réalité.

Au-delà du fait de ressusciter des stars de cinéma, l’IA créative (ou générative) a le potentiel de réduire la quantité de travail ennuyeux et répétitif que les humains doivent faire

Il est déjà arrivé que des criminels créent de fausses voix pour tromper les systèmes bancaires et transférer de l’argent entre plusieurs comptes (dans un cas, cette fraude s’élevait à 35 millions de dollars). La création de défenses technologiques contre ces attaques est l’une des responsabilités d’Eric Haller et d’autres personnes occupant le même poste.

« Il pourrait s’agir d’une personne totalement fictive », indique-t-il. « Il est probablement moins difficile de créer une personne qui n’existe pas que de simuler une personne qui existe et d’avoir un dialogue interactif avec elle. […] Ma plus grande crainte […] est l’interaction qui trompe quelqu’un qui connaît la personne avec laquelle il interagit. Je pense que nous en sommes loin […], cela nécessite une confluence de technologies qui doivent encore se développer davantage. Mais le résultat aujourd’hui est très crédible. »

Comme pour d’autres formes de détection de fraude par l’IA utilisées par les organisations de services financiers, les enquêteurs ont trouvé plus fructueux de se concentrer sur l’examen des détails accessoires et circonstanciels de l’interaction plutôt que sur l’interaction elle-même. Ainsi, plutôt que d’essayer de déterminer si une voix au téléphone est générée par ordinateur, les enquêteurs se concentrent sur la manière dont la communication est établie, d’où elle provient, à quelle heure elle a lieu et si les parties concernées risquent d’être la cible d’une fraude.

Les dangers ne sont que plus évidents si l’on considère le rythme rapide auquel des univers entiers se développent en ligne et l’étroite frontière entre vie réelle et vie virtuelle, notamment avec la création de concepts comme le métavers.

« J’ai entendu des collègues dire que nous avons probablement assisté à une accélération de dix ans dans le numérique au cours des 18 derniers mois en raison de la pandémie. Mon beau-père de 95 ans commande maintenant ses courses en ligne, alors qu’il y a un an et demi, cela ne serait jamais arrivé », explique Eric Haller.

De plus en plus d’interactions se déroulant par appel Zoom, qu’il s’agisse de réunions d’affaires ou de consultations médicales, les possibilités d’usurpation d’identité ne feront que croître, et c’est la raison pour laquelle le travail des professionnels de l’identité, comme Eric Haller, sera de plus en plus important à l’avenir pour la société.

Parallèlement, l’on ne devrait pas ignorer les avantages de l’hypertrucage. Au-delà du fait de ressusciter des stars de cinéma, l’IA créative (ou générative) a le potentiel de réduire la quantité de travail ennuyeux et répétitif que les humains doivent faire. Elle est également très utile pour créer des « données synthétiques », ce qui permet d’entraîner l’IA et les robots à devenir plus précis en utilisant des données qu’il serait autrement difficile ou dangereux de se procurer. Par exemple, l’on pourrait former des algorithmes de conduite autonome sans les risques liés à de véritables trajets sur route ou réaliser des essais médicaux sans mettre en danger la vie des patients humains ou animaux.

La possibilité pour l’IA de simuler (ou de contrefaire) des éléments du monde réel est clairement l’un des aspects les plus puissants du potentiel novateur de cette technologie sur la société. Veiller à ce que ce potentiel soit réalisé de manière sûre, sans causer de dommages, est une tâche importante pour ceux qui développent et déploient cette technologie.

Article traduit de Forbes US – Auteur : Bernard Marr

<<< À lire également : Incroyable ! MyHeritage anime nos ancêtres grâce à la technologie deepfake >>>

Vous avez aimé cet article ? Likez Forbes sur Facebook

Newsletter quotidienne Forbes

Recevez chaque matin l’essentiel de l’actualité business et entrepreneuriat.

Abonnez-vous au magazine papier

et découvrez chaque trimestre :

- Des dossiers et analyses exclusifs sur des stratégies d'entreprises

- Des témoignages et interviews de stars de l'entrepreneuriat

- Nos classements de femmes et hommes d'affaires

- Notre sélection lifestyle

- Et de nombreux autres contenus inédits